DRRN: Image Super-Resolution via Deep Recursive Residual Network. CVPR 2017

1 文章摘要

DRRN的方法来用于单图Y通道上的超分。

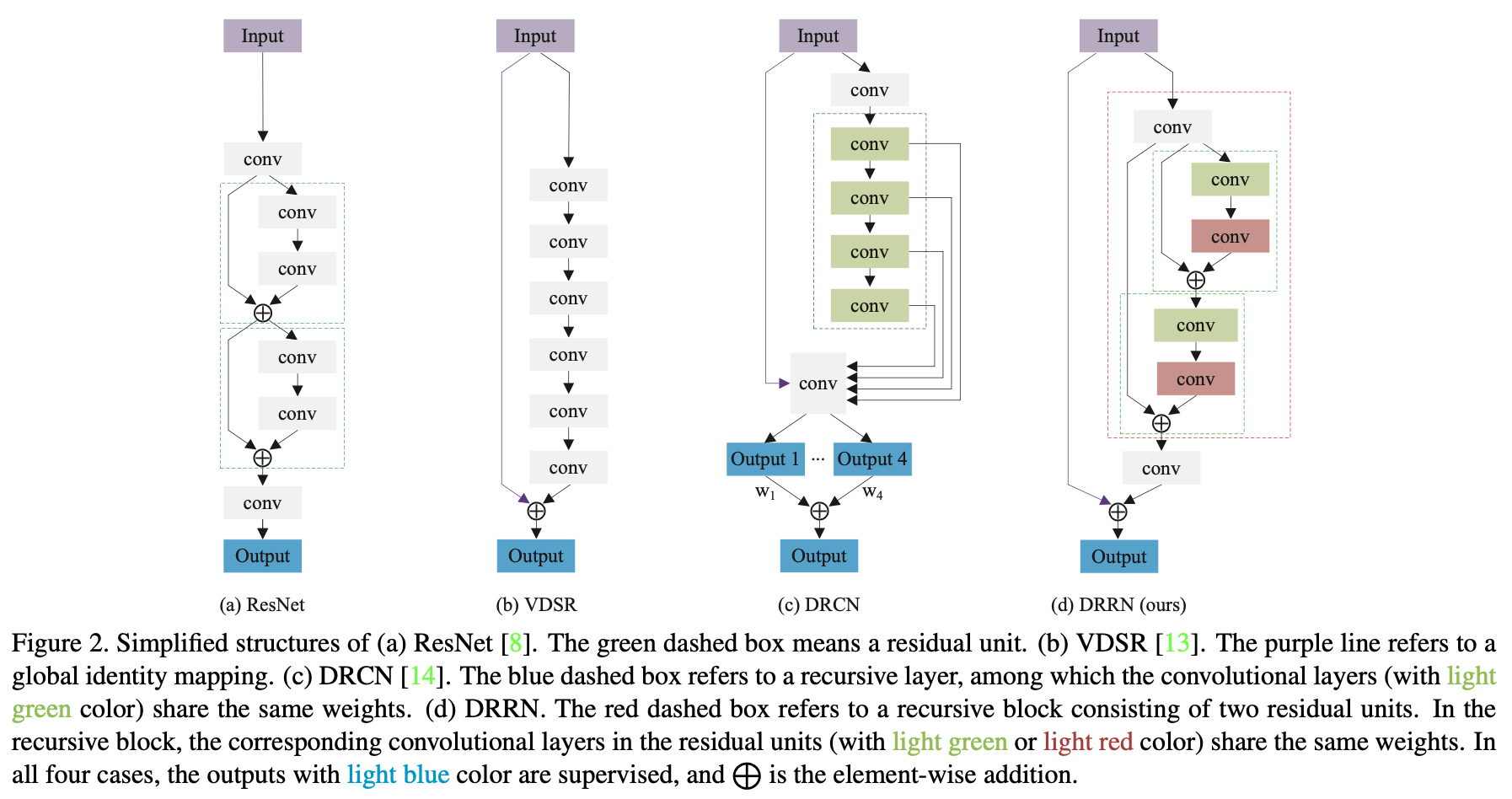

DRRN的作者应该是受到了ResNet、VDSR和DRCN的启发,采用了更深的网络结构来获取性能的提升。

DRRN中的每个残差单元都共同拥有一个相同的输入,即递归块中的第一个卷积层的输出。每个残差单元都包含2个卷积层。

在一个递归块内,每个残差单元内对应位置相同的卷积层参数都共享(图中DRRN的浅绿色块或浅红色块)。

作者列出了ResNet、VDSR、DRCN和DRRN四者的主要策略。

ResNet是链模式的局部残差学习。

- VDSR是全局残差学习。

- DRCN是全局残差学习+单权重的递归学习+多目标优化。

- DRRN是多路径模式的局部残差学习+全局残差学习+多权重的递归学习。

文章中比较了不同的递归块和残差单元数量的实验结果,最终选用的是1个递归块和25个残差单元,深度为52层的网络结构。

总之,DRRN就是通过对之前已有的ResNet等结构进行调整,采取更深的网络结构得到结果的提升。

2 网络结构

3 创新点

- 更深的网络层次,其实最近的关于图像超分辨率的论文都是一个基调,越深越好,不过深度增加的网络对梯度传播带来困难,最近的论文如VDSR,DRCN,LapSRN都采取了相关的解决措施,当然,此篇论文采取的是VDSR的调整梯度裁剪加 DRCN的递归学习,

递归学习,其实这不算是一个创新点,无论是DRCN还是ResNet都有递归模块,不过此篇的递归模块更接近于DRCN,递归模块中权重共享减少了模型所需要的参数,从而保证不发生梯度爆炸或者梯度消失。

残差学习,残差学习可以算是图像超清方面的一个很好的学习策略,由于低分辨率图片与高分辨率图片在图片信息上有很多地方是共享的,于是,可以只学习低分辨率与高分辨率之间的差别也就是残差,并将残差与低分辨率做element-wise也就是矩阵相加,从而得到高清结果,学习残差的好处就是 对网络的参数要求低,网络不需要记忆太多的图片细节,从而有利于梯度传输,防止梯度消失或者梯度爆炸。

全局和局部残差学习。每个递归块中都使用局部残差学习,然后总体在模型的输出层那里加上一个全局残差学习,整体模型中只有一个全局残差学习和多个局部残差学习。

残差单元的递归学习。